Par Amal Nazaal

Ces dernières années, un nombre croissant de Palestiniens ont dénoncé la suppression de leur droit d’expression par les plateformes dominantes des médias sociaux, telles que Facebook, WhatsApp, Twitter et YouTube. En 2019, Sada Social, une organisation palestinienne de défense des droits numériques, a documenté près de 1000 violations, dont la suppression de pages publiques, de comptes, de messages, de publications, et les restrictions d’accès.

Pourtant, nous savons peu de choses sur les politiques et les pratiques de YouTube à l’égard du contenu numérique palestinien, si ces politiques sont conformes au droit des droits de l’homme en général, et comment elles sont appliquées au contenu palestinien.

Cette étude s’appuie sur les recherches menées par 7amleh – The Arab Center for the Advancement of Social Media, pour scruter la politique et les directives communautaires de YouTube, sa modération du contenu des médias sociaux, et sa violation des droits numériques des Palestiniens par l’hyper-surveillance.

L’analyse s’appuie sur des entretiens menés avec des journalistes palestiniens, des défenseurs des droits de l’homme, des militants et des organisations internationales de défense des droits de l’homme, telles que WITNESS et Article 19.

La note de synthèse examine les principales conclusions des entretiens, notamment la définition vague et problématique du “contenu violent”, qui est utilisée pour restreindre le contenu publié par les YouTubers palestiniens, ainsi que les pratiques violentes de YouTube, telles que la discrimination linguistique et locative.

Lire également : Bientôt un logiciel espion israélien dans tous nos téléphones portables ?

Enfin, cette étude se conclut par des recommandations à YouTube, aux organisations de la société civile, aux décideurs politiques, aux militants et défenseurs des droits de l’homme, ainsi qu’aux utilisateurs des médias sociaux, pour protéger les droits numériques des Palestiniens.

“Votre vidéo viole les directives de notre communauté”

YouTube, la plateforme américaine de partage de vidéos, a été créée en février 2005 et a été rachetée par Google en novembre 2006 pour 1,65 milliard de dollars. En 2019, les revenus de l’entreprise s’élevaient à 136,819 milliards de dollars, ce qui en fait l’une des entreprises ayant les plus gros revenus au monde.

En effet, environ 500 heures de vidéo sont mises en ligne sur YouTube chaque minute. En 2019, le nombre de chaînes YouTube a augmenté de 27 % pour atteindre plus de 37 millions de chaînes.

Avec la popularité et l’influence croissantes des contenus vidéo, la société détenue par Google est devenue l’un des plus importants canaux de distribution de contenus numériques dans le monde. Au Moyen-Orient, le taux d’utilisation de YouTube a augmenté de 160 % entre 2017 et 2019, avec plus de 200 chaînes YouTube dans la région qui comptent plus d’un million d’abonnés.

Malgré la popularité de YouTube, beaucoup ont critiqué ses politiques et ses pratiques sur la façon dont il gère et modère son contenu.

Entre autres politiques et pratiques controversées, YouTube a fait face à des critiques concernant ses algorithmes qui contribuent à populariser des vidéos qui promeuvent des théories conspirationnistes et des mensonges, ainsi que des vidéos qui visent ostensiblement les enfants mais qui contiennent également des contenus violents et/ou sexuellement suggestifs.

Au niveau régional, en particulier en Syrie, de nombreuses violations des droits numériques sur YouTube ont été enregistrées et documentées. Pendant plusieurs années, au cours du soulèvement syrien, le journaliste et photographe syrien Hadi al-Khatib a rassemblé 1,5 million de vidéos documentant les violations des droits de l’homme dans le pays, y compris des images de centaines d’attaques chimiques menées par le régime syrien, preuves qui seraient essentielles pour poursuivre les auteurs de crimes de guerre.

Chaîne YouTube : Palestine 27k

Pourtant, al-Khatib a rapporté qu’en 2018, plus de 200 000 vidéos, soit 10 % des vidéos qu’il avait téléchargées, ont été retirées et ont disparu de YouTube. La suppression de vidéos en temps de crise et de guerre a de graves conséquences, et peut entraîner l’effacement de preuves déterminantes lors de procès à venir.

Bien que la profession de foi de YouTube promette de “donner la parole à chacun et de montrer le monde”, ce n’est pas toujours le cas avec sa déclaration permanente et injustifiée selon laquelle certaines vidéos violent les directives de sa communauté. YouTube a quatre principales directives et politiques qui sont énumérées dans ses lignes directrices communautaires : le spam et les pratiques trompeuses, les sujets sensibles, les contenus violents ou dangereux et les biens réglementés.

Cependant, de nombreux utilisateurs ont accusé YouTube de supprimer des vidéos sans pour autant se soucier de ses propres directives.

Cela soulève des problèmes importants en ce qui concerne les droits numériques des utilisateurs. Tout d’abord, cela prouve que YouTube n’est pas tenu de rendre compte de la clarté et de l’équité de ses quatre lignes directrices ; il peut manœuvrer entre elles de manière interchangeable pour justifier le retrait de contenus.

Barbara Dockalova, responsable de campagne pour Article 19, a expliqué que toutes ces obscures politiques de YouTube pouvaient être utilisées pour retirer du contenu : si votre vidéo n’a pas été supprimée sous la rubrique ‘contenu violent ou choquant’, elle peut l’être sous la rubrique ‘contenu préjudiciable ou dangereux'”.

Un autre membre d’Article 19, Gabrielle Guillemin, a ajouté que YouTube est vague dans la définition de certains termes : “Le terrorisme, par exemple, est défini différemment selon YouTube, car certains des défenseurs des droits de l’homme avec lesquels nous avons travaillé étaient considérés comme des terroristes”. Par conséquent, en septembre 2018, Article 19 a recommandé à YouTube d’aligner sa définition du terrorisme sur celle proposée par le rapporteur spécial des Nations unies sur la lutte contre le terrorisme et pour les droits de l’homme.

Lire également : Les Palestiniens combattent la censure de Facebook et YouTube

Article 19 a également confirmé que les politiques et les directives communautaires de YouTube sont en deçà des normes juridiques internationales en matière de liberté d’expression.

Dans sa déclaration de 2018, Article 19 a demandé à YouTube de faire preuve de transparence sur la manière dont il applique ses lignes directrices dans la pratique en fournissant des exemples détaillés, des études de cas et des explications approfondies sur ce qu’il considère comme des contenus “violents”, “offensants” et “abusifs”, y compris le “discours de haine” et les attaques “malveillantes”.

Ensuite, les entretiens menés dans le cadre de cette étude indiquent que, alors que YouTube s’obstine à retirer sans discernement les contenus qu’il juge inappropriés, il a tendance à conserver, voire à défendre, des contenus très problématiques. En juin 2019, YouTube a décidé que plusieurs messages homophobes haineux contre le producteur américain, Carlos Maza, n’enfreignaient pas ses conditions.

Puis, en août 2019, des créateurs de contenu LGBTQ+ sur YouTube en Californie ont intenté une action en justice contre YouTube, affirmant que l’algorithme de YouTube est discriminatoire à l’égard du contenu LGBTQ+, les outils de modération de l’apprentissage machine et les évaluateurs humains ciblant injustement les canaux dont le titre comporte des mots tels que “gay”, “bisexuel” ou “transgenre”.

En mai 2020, l’intelligence artificielle (IA) de YouTube a été accusée de supprimer automatiquement les commentaires contenant certaines phrases en chinois considérées comme critiques à l’égard du Parti communiste (PCC) au pouvoir dans les 15 secondes suivant le moment où un utilisateur de YouTube laissait un commentaire sous les vidéos ou dans les flux en direct.

L’affaire du PCC a montré comment YouTube conçoit la prise de décision automatisée (programmation de l’IA) pour signaler et supprimer en masse certains contenus à des fins politiques, quel que soit le contexte.

L’une des justifications de YouTube pour l’utilisation de l’exploitation d’IA est qu’elle devrait être beaucoup plus efficace pour détecter les contenus inappropriés, car des quantités massives de vidéos sont téléchargées chaque minute, rendant impossible toute vérification manuelle. Cependant, Dia Kayyali, de WITNESS, explique que le problème de l’utilisation de l’IA pour examiner les contenus est que, si “les ordinateurs peuvent être efficaces pour détecter la violence, ils ne sont pas aussi nuancés que les humains. Ils ne sont pas capables de déterminer si une vidéo est de la propagande ISIS ou une preuve évidente de violation des droits de l’homme”.

En conséquence, poursuit-elle, “la politique de modération des contenus de YouTube est devenue une épée à double tranchant, où des contenus essentiels sur les droits de l’homme sont pris dans le filet”.

Faire la promotion des contenus pro-israéliens et faire taire les Palestiniens

La collaboration entre les unités de sécurité israéliennes et les plateformes de médias sociaux comme Facebook, WhatsApp et Twitter, est de plus en plus documentée. En effet, le bureau du procureur général d’Israël gère illégalement une “cyber-unité” pour censurer les contenus palestiniens et surveiller les comptes des médias sociaux palestiniens.

De plus, les forces de sécurité israéliennes et de l’Autorité palestinienne (AP) ont arrêté 800 Palestiniens en exploitant des programmes d’IA en raison de leurs publications sur les médias sociaux, notamment sur Facebook. Cependant, nous manquons encore d’informations sur les tendances pro-israéliennes de YouTube.

Dans une série de vidéos, les chercheurs ont constaté que de nombreuses publications sur l’armée et les militaires israéliens restaient sur YouTube, indépendamment de leur célébration explicite de la militarisation et de la violence. Ce développement sans entrave de contenus israéliens qui promeuvent et célèbrent sans équivoque l’usage mortel de la force est devenu si normal qu’il est maintenant commercialisable sur YouTube.

Lire également : Twitter et Facebook obéissent au doigt et à l’oeil aux autorités d’occupation

Le tout sur une plateforme dont les normes communautaires sont supposées restreindre les images de violence, et qui a même une “politique de contenu sur les armes à feu”. Dans le cadre de cette politique, YouTube affirme que “Tout contenu qui promeut des armes à feu, qui enseigne aux internautes comment fabriquer des armes à feu, des munitions et certains accessoires, ou comment installer ces accessoires n’est pas autorisé sur YouTube”.

Malgré cette prétendue politique, YouTube fait la promotion de “Alpha Gun Models”, une entreprise dirigée par le modèle israélien Orin Julie pour les armes à feu. Julie a plus de 440 000 adeptes sur Instagram, et une célèbre chaîne YouTube intitulée “Je suis la reine des armes”, avec plus de 2870 abonnés. Sur son compte Instagram, elle se définit comme une promotrice de sociétés d’armes à feu, ce qui constitue une violation flagrante de la politique de YouTube en matière de contenu sur les armes à feu. Mais malgré cela, YouTube continue de promouvoir son contenu.

Un autre incident de discours de haine et de harcèlement qui révèle le double standard de YouTube est la vidéo promue par la marque de vêtements israélienne Hoodies. Dans cette vidéo, le mannequin israélien Bar Refaeli enlève un niqab avant de porter une gamme de vêtements différents. La vidéo islamophobe se termine par le slogan “La liberté est fondamentale”. Refaeli a partagé la vidéo de 30 secondes sur sa page Facebook, un compte avec près de trois millions de followers, et malgré les critiques des militants, la vidéo reste sur YouTube.

YouTube a été une plateforme particulièrement importante pour les défenseurs et lmilitants palestiniens des droits de l’homme qui documentent les violations israéliennes et les partagent sur YouTube dans l’espoir de sensibiliser l’opinion publique et de faire en sorte que le régime israélien rende des comptes. Cependant, plusieurs défenseurs des droits de l’homme ont vu leur contenu retiré, ce qui a nui aux efforts d’archivage et de documentation des violations israéliennes contre les enfants, les personnes handicapées et les Palestiniens dans leur ensemble.

Des entretiens avec des défenseurs palestiniens des droits de l’homme ont mis en évidence que YouTube supprime leur contenu sous prétexte qu’il est “violent”. Selon le journaliste palestinien Bilal Tamimi, YouTube a violé son droit de publier une vidéo montrant des soldats israéliens violentant un garçon de douze ans dans le village de Nabi Saleh.

C’est avec tristesse qu’il a déclaré : “YouTube comprend ce qui viole ses propres termes et conditions, pas ce qui nous viole en tant que Palestiniens.” Il a poursuivi : “Pourquoi me servirais-je de YouTube si je ne peux pas signaler les violations auxquelles les Palestiniens, et les enfants palestiniens en particulier, sont confrontés quotidiennement ?”

Au final, Tamimi a intégré la vidéo supprimée dans une vidéo plus longue qui a alors passé le test d’IA de YouTube, une tactique utilisée pour contourner les suppressions de contenu de la plateforme.

De même, le rédacteur en chef d’Al-Quds News, Iyad Al-Refaie, a expliqué dans son interview : “La violence varie en fonction de YouTube. Par exemple, lorsque YouTube voit une vidéo d’un enfant palestinien tué par l’armée israélienne, il a des problèmes pour la publier, mais il est d’accord pour promouvoir la militarisation israélienne et les vidéos d’enfants israéliens entraînés à tirer au fusil”.

Une des vidéos auxquelles Al-Refai a fait référence montre des enfants israéliens apprenant à porter une arme, ainsi que d’autres chaînes israéliennes de YouTube célébrant la violence militarisée israélienne.

Une intelligence artificielle faite pour discriminer

Lors d’entretiens, des défenseurs palestiniens des droits de l’homme ont déclaré avoir été victimes de discrimination linguistique et locative à l’égard de leur contenu sur YouTube. En d’autres termes, ils ont fait savoir que leurs vidéos en langue arabe, qui comportent des titres ou des sous-titres arabes, sont davantage surveillées par YouTube que les vidéos publiées dans d’autres langues.

Outre la discrimination linguistique, le militant et journaliste palestinien Muath Hamed a expliqué que les systèmes informatisés d’IA de surveillance de YouTube sont conçues et mises en œuvre pour un niveau de surveillance plus élevé des contenus provenant de Cisjordanie et de Gaza – ce que l’on appelle la “discrimination locative”.

Hamed, qui est un YouTuber actif, a expliqué la discrimination linguistique qu’il a subie sur YouTube. Sa chaîne personnelle sur YouTube, “Palestine 27K“, compte 10 500 abonnés, avec environ 897 vidéos. Il a expliqué qu’un grand nombre de ses vidéos étaient signalées et supprimées, et que la seule explication était qu’elles comportaient des contenus en langue arabe.

Comme il l’explique : “D’une manière ou d’une autre, nos vidéos qui ont des titres ou des sous-titres en arabe sont davantage surveillées par YouTube”.

Il a cependant ajouté qu’il était à même de comprendre exactement comment le lexique de YouTube discrimine le contenu en langue arabe, et par conséquent, comment échapper à la détection : “J’ai acquis une plus grande expérience des politiques et des tactiques de surveillance de YouTube […] Avec le temps, j’ai développé un lexique YouTube […] Par exemple, Hamas, Jihad islamique, Hezbollah, etc. sont des mots-clés qui seront fortement signalés. […] J’ai donc commencé à flouter certains éléments dans la vidéo, comme les drapeaux des partis politiques.”

Hamed, qui à l’époque résidait en Cisjordanie, a révélé une réalité choquante sur la discrimination locative de YouTube à l’encontre des Palestiniens dans une simple expérience en ligne : “J’ai envoyé la même vidéo supprimée de mon compte YouTube au compte YouTube de mon ami en Europe […] et YouTube n’avait aucun problème avec la même vidéo publiée dans un pays européen.”

Muath Hamed et Samer Nazzal, un journaliste palestinien et YouTuber vivant à Ramallah, affirment que le système d’IA de YouTube hyper-évalue le contenu palestinien, en particulier lorsqu’il présente un nombre élevé d’opinions et commence à devenir influent. Ils ont remarqué qu’après que leurs vidéos aient reçu un certain nombre de visites (l’une sur un garçon palestinien jetant des pierres sur un soldat israélien, et l’autre sur Ahed Tamimi à Nabi Saleh demandant aux soldats israéliens de libérer son frère), YouTube a commencé à suivre leurs vidéos, même anciennes, celles-ci subissant plus de blocages, et même des pertes de recettes financières en guise de punition.

En d’autres termes, en guise de mesure de rétorsion, les usagers de YouTube perdent la possibilité de gagner des revenus publicitaires sur leurs contenus.

Lire également : Facebook collabore activement avec l’État de l’apartheid pour censurer les Palestiniens

On ne sait pas très bien comment le service YouTube IA modère son contenu en ligne, comment est recruté son personnel ou comment est appliquée la surveillance numérique dans des contextes spécifiques. Barbara Dockalova, membre de l’Article 19, explique : “Nous savons peu de choses sur la façon dont les données sont traitées, dont les algorithmes sont développés […] YouTube ne partage pas ce genre d’informations […] Nous savons aussi très peu de choses sur le personnel de YouTube. Comment sont-ils formés ? Connaissent-ils le contexte ? Comment se déroule le processus de révision ?”

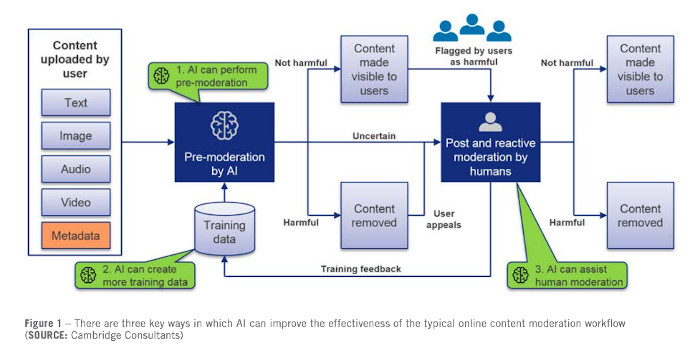

Pour mieux comprendre comment l’IA peut être conçue avec des objectifs discriminatoires, comme la discrimination linguistique et locative, il est utile d’expliquer comment l’IA peut être programmée pour interférer dans le processus de modération en ligne. La figure ci-dessous montre le déroulement des opérations de l’IA pour accroître l’efficacité d’une entreprise en matière de modération de contenu en ligne. Les trois façons, indiquées en vert, montrent où les algorithmes d’IA peuvent être conçus et formés pour fonctionner de manière discriminatoire. Mais comment, exactement, cette discrimination se produit-elle ?

Premièrement, le flux de données soumises à l’étude permet à l’IA biaisée d’évaluer le contenu de l’utilisateur, tel que le texte, l’image, l’audio ou la vidéo, comme étant nuisible ou non, ce qui produit automatiquement une décision biaisée. Ce processus est appelé “pré-modération”. Deuxièmement, l’IA biaisée est programmée pour créer automatiquement plus de données de d’analyse et aider les modérateurs humains, ce qui reproduit plus de données biaisées et de décisions discriminatoires. Mais comment former les algorithmes de l’IA pour qu’ils fonctionnent de cette manière discriminatoire ?

Il existe certaines façons d’entraîner les algorithmes d’IA à le faire. Il s’agit notamment du “hash matching”, qui consiste à comparer l’empreinte digitale d’une image avec une base de données d’images nocives connues, ou du “keyword filtering”, qui consiste à utiliser des mots indiquant un contenu potentiellement nocif pour signaler un contenu particulier.

Le fait de savoir quel contenu est inclus dans la base de données des contenus considérés comme préjudiciables pourrait conduire à des cas évidents de discrimination. Par exemple, les services de renseignement israéliens utilisent des algorithmes pour censurer les comptes Facebook de dizaines de milliers de jeunes Palestiniens en signalant des mots tels que shaheed (martyr), État sioniste, Al-Quds (Jérusalem) ou Al-Aqsa, en plus des photos de Palestiniens récemment tués ou emprisonnés par Israël.

Les militants, YouTubers et journalistes interrogés dans le cadre de cette étude ont exprimé leur sentiment d’être discriminés et exclus d’une puissance numérique dominante comme YouTube, en plus de ressentir de la colère, de la déception et de la démotivation pour continuer à être actifs sur YouTube. Cependant, les participants ont également proposé différentes tactiques et techniques pour échapper et faire face à cette discrimination, telles que la conservation de vidéos de sauvegarde à tout moment, l’utilisation de plateformes alternatives telles que Vimeo et Dailymotion, et le projet en cours de développer un lexique YouTube pour contrer ses politiques biaisées.

Recommandations

Les politiques et les directives communautaires de YouTube sont en deçà du droit international et des normes de liberté d’expression, que YouTube est supposé devoir respecter. De plus, les définitions des termes clés de YouTube dans ses directives communautaires, tels que “contenu violent”, sont vagues et problématiques et, en fait, violent les droits numériques des utilisateurs.

En effet, l’IA de YouTube viole les droits numériques des Palestiniens en mettant en œuvre des biais algorithmiques contre la langue arabe et contre les contenus provenant de Cisjordanie et de Gaza.

Pour contrer ces pratiques discriminatoires et protéger les Palestiniens militants, journalistes et YouTubers, les recommandations suivantes devraient être mises en œuvre :

* Les directives de la communauté YouTube doivent respecter la législation et les normes relatives aux droits de l’homme. YouTube doit offrir un accès égal à l’information et veiller à ce que ses lignes directrices communautaires soient disponibles, avec toutes les précisions nécessaires, dans les langues officielles des Nations unies, y compris l’arabe.

* Une tierce partie, un groupe de surveillance de la société civile, comme les organisations de défense des droits de l’homme et/ou des droits numériques, doit s’assurer qu’AI n’effectue pas d’hyper-surveillance du contenu palestinien et ne fait pas de discrimination à son encontre. La tierce partie doit également servir d’instance de jugement, en aidant les utilisateurs à faire appel et à protester contre le retrait de leur contenu. Les utilisateurs de YouTube doivent avoir le droit de contester les décisions lorsque leur contenu est retiré.

* YouTube doit publier des rapports de transparence pour les suppressions, les blocages ou les restrictions de contenu et de profils des utilisateurs palestiniens ; il doit publier le nombre de demandes de restriction de contenu par acteur, le nombre de demandes approuvées et les raisons de l’approbation ou du rejet des demandes ; il doit expliquer clairement comment une personne peut faire appel de la décision, et donner un délai de réponse raisonnable avec les coordonnées de contact pour plus d’informations.

* L’Autorité palestinienne doit soutenir les poursuites engagées par les Palestiniens contre les plateformes de médias sociaux qui violent leurs droits numériques, et elle doit désigner des avocats pour les aider.

* Les organisations de la société civile palestinienne doivent sensibiliser les utilisateurs palestiniens à leurs droits numériques et les informer sur la manière de s’exprimer et de résister à ces pratiques discriminatoires.

* Les militants, les journalistes et les défenseurs des droits de l’homme engagés dans des plateformes en ligne devraient partager des stratégies et des tactiques pour éviter la discrimination linguistique et locale, entre autres formes de violation. Ils devraient également s’efforcer de développer des technologies permettant de contrer l’AI biaisée de YouTube.

* Dr. Amal Nazzal est professeur assistante à la faculté de Commerce et d’Économie de l’université de Birzeit, en Palestine. Elle a obtenu son doctorat à l’Université d’Exeter (UK), où elle a étudié la pertinence des théories de Bourdieu pour l’étude des pratiques, mécanismes et dynamiques dans les organisations socioculturelles. Elle s’est notamment intéressée aux mouvements sociaux à motivation politique.

* Dr. Amal Nazzal est professeur assistante à la faculté de Commerce et d’Économie de l’université de Birzeit, en Palestine. Elle a obtenu son doctorat à l’Université d’Exeter (UK), où elle a étudié la pertinence des théories de Bourdieu pour l’étude des pratiques, mécanismes et dynamiques dans les organisations socioculturelles. Elle s’est notamment intéressée aux mouvements sociaux à motivation politique.

27 décembre 2020 – Al-Shabaka – Traduction : Chronique de Palestine – Lotfallah